Facebook se enfrenta a los superpropagadores de la desinformación

Jinhwa Oh | The New York Times

Solo se necesitó una crisis sanitaria global y la gran mentira de una elección amañada para que las grandes empresas de internet finalmente se lo tomaran en serio.

Las grandes empresas de internet finalmente están tomando en serio a los superpropagadores de la desinformación. (Todo lo que hizo falta fue una crisis sanitaria mundial y la gran mentira de unas elecciones amañadas).

He escrito sobre personas influyentes, incluido el expresidente estadounidense Donald Trump, quienes han sido fundamentales en la difusión de información falsa en internet sobre temas importantes como la integridad de las elecciones y la seguridad de las vacunas. Algunas de esas mismas personas han tergiversado de manera repetida nuestras creencias y las empresas de internet les han dado vía libre.

Analicemos por qué los habituales propagadores de desinformación son importantes y cómo las empresas de internet han comenzado a centrarse en ellos, incluyendo las nuevas reglas establecidas por Facebook hace unos días.

Facebook, Twitter y YouTube merecen reconocimiento por comenzar a abordar el problema de los infractores reincidentes de la desinformación. Pero también quiero que la gente sea consciente de los límites de las acciones de las empresas y que comprenda el desafío de aplicar estas políticas de manera justa y transparente.

¿Hasta qué punto es un problema la gente que publica falsedades repetidamente?

Muchas cosas que la gente dice en línea no son necesariamente ciertas o falsas. Queremos espacio para lo impreciso. Lo que preocupa es cuando la información es completamente falsa y sabemos que algunas personas son responsables de amplificar esa información errónea una y otra vez.

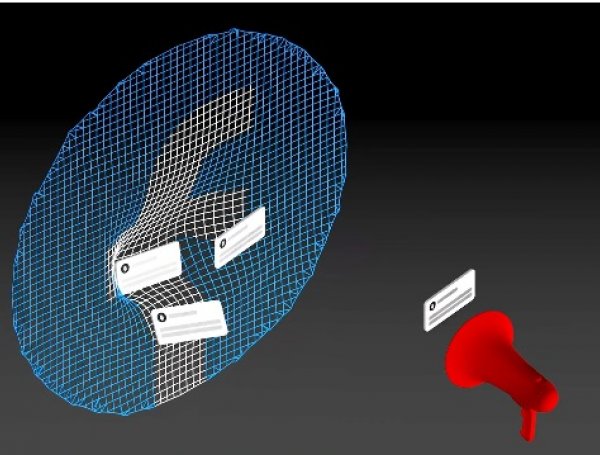

El pasado otoño, una coalición de investigadores sobre la desinformación descubrió que aproximadamente la mitad de todos los retuits relacionados con múltiples afirmaciones falsas, y difundidas ampliamente, acerca de una interferencia electoral se remontan a solo 35 cuentas de Twitter, incluidas las de Trump y el activista conservador Charlie Kirk. Un grupo de investigación identificó recientemente las cuentas en redes sociales de una decena de personas, incluido Robert F. Kennedy Jr., que repetidamente -a veces durante años- promovió información desacreditada sobre vacunas o, más recientemente, sobre falsas “curas” para la COVID-19.

Hasta hace poco, no importaba si la mayoría de las veces alguien publicó información inservible de salud o una falsa teoría de conspiración electoral, una o 100 veces, o si la persona era Justin Bieber o tu primo con cinco seguidores en Facebook. Generalmente las empresas de internet evaluaron la esencia de cada mensaje únicamente de forma aislada. Eso no tiene sentido.

¿Cómo las políticas comienzan a enfocarse en estos infractores habituales?

El 6 de enero, el asalto al Capitolio de Estados Unidos mostró el peligro de repetir falsedades ante un público inclinado a creerlas. Las empresas de internet comenzaron a abordar la enorme influencia de personas con muchos seguidores que habitualmente difunden información falsa.

La semana pasada, Facebook dijo que aplicaría castigos más estrictos a las cuentas individuales que repetidamente publican cosas que los verificadores de datos de la compañía han considerado engañosas o falsas. Las publicaciones de infractores habituales se distribuirán menos en el servicio de noticias de Facebook, lo que significa que es menos probable que otros las vean. En marzo, la compañía promulgó una política similar para los grupos de Facebook.

Hace un par de meses, Twitter creó un sistema de “cinco advertencias” en el que se aumentan las sanciones para quienes tuitean información errónea sobre las vacunas contra la COVID-19. Las empresas de internet han suspendido las cuentas de algunos de los reincidentes, incluida la de Kennedy.

Es demasiado pronto para evaluar si estas políticas están reduciendo de manera efectiva la difusión de información totalmente falsa, pero vale la pena poner fin a la impunidad de las personas que habitualmente promueven información desacreditada.

Aquí es donde se complica

Diferenciar los hechos de la ficción puede ser un desafío. Facebook había prohibido a las personas publicar sobre la teoría de que el coronavirus podría haberse originado en un laboratorio chino. Esa idea, que alguna vez se consideró una teoría de la conspiración, ahora se está tomando más en serio. Facebook cambió de opinión esta semana y dijo que ya no eliminaría las publicaciones que hicieran esa afirmación.

No es fácil implementar reglas especiales para evitar que las personas con grandes cuentas engañen al público sobre temas candentes y complicados. Pero como muestra el asalto al Capitolio, las plataformas tienen que resolver esto.

Aunque las empresas de internet han decidido intervenir, las preguntas difíciles continúan: ¿cómo hacen cumplir las reglas? ¿Se aplican de manera equitativa? (YouTube ha tenido durante mucho tiempo una política de “tres faltas” para las cuentas que infringen repetidamente sus reglas, pero parece que algunas personas reciben faltas infinitas y otras no saben qué hicieron para incumplir las políticas del sitio).

Las empresas de internet no son responsables de la fealdad de la humanidad. Pero durante demasiado tiempo Facebook, Twitter y YouTube no se tomaron lo suficientemente en serio el impacto de las personas con influencia que repetidamente difundían información falsa y peligrosa. Deberíamos alegrarnos de que finalmente estén tomando medidas más contundentes.

Shira Ovide escribe el boletín On Tech, una guía sobre el modo en el que la tecnología está remodelando nuestras vidas y el mundo. @ShiraOvide